37. Определение мультиколлинеарности. Последствия мультиколлинеарности. Методы обнаружения мультиколлинеарности

37. Определение мультиколлинеарности. Последствия мультиколлинеарности. Методы обнаружения мультиколлинеарности

Наибольшие затруднения в использовании аппарата множественной регрессии возникают при наличии мультиколлинеарности факторных переменных, когда более чем два фактора связаны между собой линейной зависимостью.

Мультиколлинеарностью для линейной множественной регрессии называется наличие линейной зависимости между факторными переменными, включёнными в модель.

Мультиколлинеарность – нарушение одного из основных условий, лежащих в основе построения линейной модели множественной регрессии.

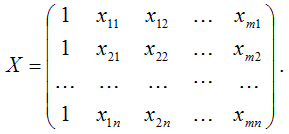

Мультиколлинеарность в матричном виде – это зависимость между столбцами матрицы факторных переменных Х:

Если не учитывать единичный вектор, то размерность данной матрицы равна n*n. Если ранг матрицы Х меньше n, то в модели присутствует полная или строгая мультиколлинеарность. Но на практике полная мультиколлинеарность почти не встречается.

Можно сделать вывод, что одной из основных причин присутствия мультиколлинеарности в модели множественной регрессии является плохая матрица факторных переменных Х.

Чем сильнее мультиколлинеарность факторных переменных, тем менее надежной является оценка распределения суммы объясненной вариации по отдельным факторам с помощью метода наименьших квадратов.

Включение в модель мультиколлинеарных факторов нежелательно по нескольким причинам:

1) основная гипотеза о незначимости коэффициентов множественной регрессии может подтвердиться, но сама модель регрессии при проверке с помощью F-критерия оказывается значимой, что говорит о завышенной величине коэффициента множественной корреляции;

2) полученные оценки коэффициентов модели множественной регрессии могут быть неоправданно завышены или иметь неправильные знаки;

3) добавление или исключение из исходных данных одного-двух наблюдений оказывает сильное влияние на оценки коэффициентов модели;

4) мультиколлинеарные факторы, включённые в модель множественной регрессии, способны сделать её непригодной для дальнейшего применения.

Конкретных методов обнаружения мультиколлинеарности не существует, а принято применять ряд эмпирических приёмов. В большинстве случаев множественный регрессионный анализ начинается с рассмотрения корреляционной матрицы факторных переменных R или матрицы (ХТХ).

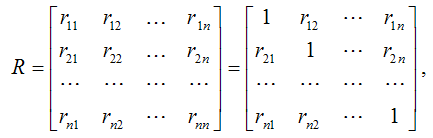

Корреляционной матрицей факторных переменных называется симметричная относительно главной диагонали матрица линейных коэффициентов парной корреляции факторных переменных:

где rij – линейный коэффициент парной корреляции между i-м и j-ым факторными переменными,

На диагонали корреляционной матрицы находятся единицы, потому что коэффициент корреляции факторной переменной с самой собой равен единице.

При рассмотрении данной матрицы с целью выявления мультиколлинеарных факторов руководствуются следующими правилами:

1) если в корреляционной матрице факторных переменных присутствуют коэффициенты парной корреляции по абсолютной величине большие 0,8, то делают вывод, что в данной модели множественной регрессии существует мультиколлинеарность;

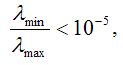

2) вычисляют собственные числа корреляционной матрицы факторных переменных ?min и ?max. Если ?min‹10-5, то в модели регрессии присутствует мультиколлинеарность. Если отношение

то также делают вывод о наличии мультиколлинеарных факторных переменных;

3) вычисляют определитель корреляционной матрицы факторных переменных. Если его величина очень мала, то в модели регрессии присутствует мультиколлинеарность.

Более 800 000 книг и аудиокниг! 📚

Получи 2 месяца Литрес Подписки в подарок и наслаждайся неограниченным чтением

ПОЛУЧИТЬ ПОДАРОКДанный текст является ознакомительным фрагментом.

Читайте также

1.3.5. Средства обнаружения и обезвреживания мин

1.3.5. Средства обнаружения и обезвреживания мин Обнаружение мин, отдельных фугасов, а также минированных участков производится:— по внешним признакам;— специальными приборами (миноискатели, щупы, стетоскопы);— собаками минорозыскной службы.*Демаскирующие признаки

Самолет дальнего радиолокационного обнаружения «Боинг» E-3

Самолет дальнего радиолокационного обнаружения «Боинг» E-3 Это было 8 мая 1942 года в Коралловом море. «В 10 часов 55 минут радиолокационная установка обнаружила большую группу вражеских самолетов, подходившую с северо-востока. В 11 часов 13 минут наблюдатели «Лексингтона»

Методы обнаружения колдунов

Методы обнаружения колдунов «Есть много способов отличить колдуна от шамана, хотя большинство людей, обладающих мощной Силой, практикуют и то и другое, – говорили чирикауа апачи. – Человек мог жить рядом с колдуном и не знать об этом. Например, колдуньей могла быть его

27. Правила и классификация методов обнаружения следов

27. Правила и классификация методов обнаружения следов 1. Первыми должны применяться неразрушающие методы. Необходимо начинать с микрометодов: не осталось ли каких-либо жировых следов, мельчайших клеточек отслоившейся кожи.2. Далее применяются неразрушающие методы,

38. Следы зубов: особенности обнаружения и их признаки

38. Следы зубов: особенности обнаружения и их признаки Достаточно распространенными являются трассологические исследования следов зубов человека. Криминалистика изучает только следы зубов на материалах, поверхностях, еде; следы на теле человека — предмет изучения

41. Особенности обнаружения, изъятия пуль и гильз

41. Особенности обнаружения, изъятия пуль и гильз В большинстве случаев гильза остается на месте преступления, способ обнаружения может быть: а) выборочный; б) сплошной.Применение выборочного способа для короткоствольного оружия таково:— устанавливается

57. Средства для обнаружения микрообъектов

57. Средства для обнаружения микрообъектов Микрообъекты — это материальные объекты, связанные с событием преступления, поиск, обнаружение, изъятие и исследование которых ввиду их малых размеров и массы затруднительны или невозможны невооруженным глазом.Действия с

58. Особенности обнаружения микрообъектов

58. Особенности обнаружения микрообъектов Поиск и обнаружение микрообъектов должны осуществляться с соблюдением мер предосторожности. Все объекты сначала осматриваются без каких-либо перемещений; при изменении положения объекта под него помещают чистый лист кальки,

4.2. Специальные инструменты для обнаружения тайников

4.2. Специальные инструменты для обнаружения тайников 4.2.1. Поисковое зеркалоОсновным инструментом для обнаружения тайников является поисковое зеркало. Оно может быть маленьким, примерно как у зубного врача, может быть и гораздо больше. Зеркало (рис. 4.2) крепится на

38. Методы устранения мультиколлинеарности

38. Методы устранения мультиколлинеарности Если оцененную модель регрессии предполагается использовать для изучения экономических связей, то устранение мультиколлинеарных факторов является обязательным, потому что их наличие в модели может привести к неправильным

Антижучок, или Средства обнаружения шпионской аппаратуры

Антижучок, или Средства обнаружения шпионской аппаратуры Как уже отмечалось, в настоящее время на российском рынке представлено великое множество самых разных шпионских устройств и разведывательной аппаратуры: скрытые микрофоны, жучки, системы скрытого