12. Оценивание неизвестных коэффициентов модели регрессии методом наименьших квадратов. Теорема Гаусса – Маркова

12. Оценивание неизвестных коэффициентов модели регрессии методом наименьших квадратов. Теорема Гаусса – Маркова

Определение коэффициентов модели регрессии осуществляется на третьем этапе схемы построения эконометрической модели. В результате этой процедуры рассчитываются оценки (приближенные значения) неизвестных коэффициентов спецификации модели.

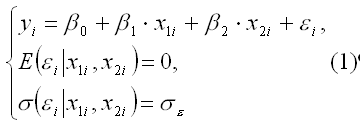

Спецификация линейной эконометрической модели из изолированного уравнения с гомоскедастичными возмущениями имеет вид:

Рассмотрим метод наименьших квадратов на примере оценивания эконометрических моделей в виде моделей парной регрессии (изолированных уравнений с двумя переменными).

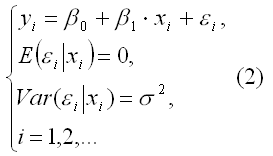

Если уравнение модели содержит две экономические переменные – эндогенную yiи предопределенную xi, то модель имеет вид:

Данная модель называется моделью линейной парной регрессии и содержит три неизвестных параметра:

?0 , ?1 , ?. (3)

Предположим, что имеется выборка: (х1, y1), (х2, y2),… (хn , yn) (4)

Тогда в рамках исследуемой модели данные величины связаны следующим образом:

y1 = a0 + a1 * x1 + u1,

y2 = a0 + a1 * x2 + u2, (5)

…

yn= a0 + a1 * x n + u n.

Данная система называется системой уравнений наблюдения объекта в рамках исследуемой линейной модели или схемой Гаусса-Маркова.

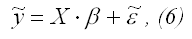

Компактная запись схемы Гаусса-Маркова:

где

– вектор-столбец известных значений эндогенной переменной yiмодели регрессии;

– вектор-столбец неизвестных значений случайных возмущений ?i;

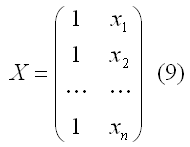

– матрица известных значений предопределенной переменной xi модели;

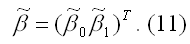

? = (?0 ?1 )Т (10) – вектор неизвестных коэффициентов модели регрессии.

Обозначим оценку вектора неизвестных коэффициентов модели регрессии как

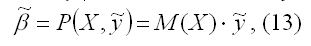

Данная оценка вычисляется на основании выборочных данных (7) и (9) с помощью некоторой процедуры:

где P (X, ?) – символ процедуры.

Процедура (12) называется линейной относительно вектора (7) значений эндогенной переменной yi, если выполняется условие:

где

(14) – матрица коэффициентов, зависящих только от выборочных значений (9) предопределенной переменной хi.

Теорема Гаусса-Маркова. Пусть матрица Х коэффициентов уравнений наблюдений (6) имеет полный ранг, а случайные возмущения (8) удовлетворяют четырем условиям:

E(?1) = E(?2) = … = E(?n) = 0, (15)

Var(?1) = Var(?2) = … = Var(?n) = ?2(16)

Cov(?i, ?j) = 0 при i?j(17)

Cov(xi,?j) = 0 при всех значениях i и j (18)

В этом случае справедливы следующие утверждения:

а) наилучшая линейная процедура (13), приводящая к несмещенной и эффективной оценке (11), имеет вид:

б) линейная несмещенная эффективная оценка (19) обладает свойством наименьших квадратов:

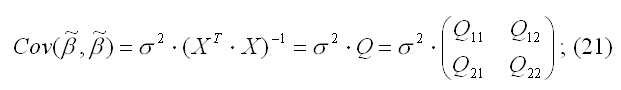

в) ковариационная матрица оценки (19) вычисляется по правилу:

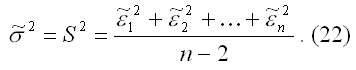

г) несмещенная оценка параметра ?2 модели (2) находится по формуле:

Следствие теоремы Гаусса-Маркова. Оценка

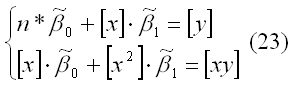

доставляемая процедурой (19) метода наименьших квадратов, может быть вычислена в процессе решения системы двух линейных алгебраических уравнений:

Данная система называется системой нормальных уравнений. Ее коэффициенты и свободные члены определяются по правилам:

[x] = x1 + x2 +…+ xn,

[y] = y1 + y2 +…+ yn, (24)

x2] = x12 + x22 +…+ xn2,

[xy] = x1*y1 + x2*y2 + … + xn*yn.

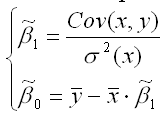

Явный вид решения системы (23):

Более 800 000 книг и аудиокниг! 📚

Получи 2 месяца Литрес Подписки в подарок и наслаждайся неограниченным чтением

ПОЛУЧИТЬ ПОДАРОКДанный текст является ознакомительным фрагментом.

Читайте также

11. Критерии оценки неизвестных коэффициентов модели регрессии

11. Критерии оценки неизвестных коэффициентов модели регрессии В ходе регрессионного анализа была подобрана форма связи, которая наилучшим образом отражает зависимость результативной переменной у от факторной переменной х:y=f(x).Необходимо оценить неизвестные

13. Система нормальных уравнений и явный вид ее решения при оценивании методом наименьших квадратов линейной модели парной регрессии

13. Система нормальных уравнений и явный вид ее решения при оценивании методом наименьших квадратов линейной модели парной регрессии Предположим, что в ходе регрессионного анализа была установлена линейная взаимосвязь между исследуемыми переменными х и у, которая

14. Оценка коэффициентов модели парной регрессии с помощью выборочного коэффициента регрессии

14. Оценка коэффициентов модели парной регрессии с помощью выборочного коэффициента регрессии Помимо метода наименьших квадратов, с помощью которого в большинстве случаев определяются неизвестные параметры модели регрессии, в случае линейной модели парной регрессии

22. Проверка гипотезы о значимости коэффициентов модели парной регрессии

22. Проверка гипотезы о значимости коэффициентов модели парной регрессии Проверкой статистической гипотезы о значимости отдельных параметров модели называется проверка предположения о том, что данные параметры значимо отличаются от нуля.Необходимость проверки

24. Проверка гипотезы о значимости модели парной регрессии. Теорема о разложении сумм квадратов

24. Проверка гипотезы о значимости модели парной регрессии. Теорема о разложении сумм квадратов Проверка гипотезы о значимости линейной модели парной регрессии состоит в проверке гипотез о значимости коэффициентов регрессии ?0 и ?1 или значимости парного коэффициента

27. Классический метод наименьших квадратов для модели множественной регрессии. Метод Крамера

27. Классический метод наименьших квадратов для модели множественной регрессии. Метод Крамера В общем виде линейную модель множественной регрессии можно записать следующим образом:yi=?0+?1x1i+…+?mxmi+?i, где yi – значение i-ой результативной переменной,x1i…xmi – значения факторных

32. Построение частных коэффициентов корреляции для модели множественной регрессии через показатель остаточной дисперсии и коэффициент множественной детерминации

32. Построение частных коэффициентов корреляции для модели множественной регрессии через показатель остаточной дисперсии и коэффициент множественной детерминации Помимо рекуррентных формул, которые используются для построения частных коэффициентов корреляции для

35. Проверка гипотезы о значимости коэффициентов регрессии и модели множественной регрессии в целом

35. Проверка гипотезы о значимости коэффициентов регрессии и модели множественной регрессии в целом Проверка значимости коэффициентов регрессии означает проверку основной гипотезы об их значимом отличии от нуля.Основная гипотеза состоит в предположении о незначимости

42. Метод наименьших квадратов для моделей регрессии, нелинейных по факторным переменным

42. Метод наименьших квадратов для моделей регрессии, нелинейных по факторным переменным Если модель регрессии является нелинейной по факторным переменным или нелинейной по оцениваемым коэффициентам, но внутренне линейной, то неизвестные коэффициенты данных моделей

43. Метод наименьших квадратов для моделей регрессии, нелинейных по оцениваемым коэффициентам

43. Метод наименьших квадратов для моделей регрессии, нелинейных по оцениваемым коэффициентам Показательная функция вида является нелинейной по коэффициенту ?1 и относится к классу моделей регрессии, которые можно с помощью преобразований привести к линейному виду.

44. Методы нелинейного оценивания коэффициентов модели регрессии

44. Методы нелинейного оценивания коэффициентов модели регрессии Функцией потерь или ошибок называется функционал вида Также в качестве функции потерь может быть использована сумма модулей отклонений наблюдаемых значений результативного признака у от теоретических

46. Проверка гипотезы о значимости нелинейной модели регрессии. Проверка гипотезы о линейной зависимости между переменными модели регрессии

46. Проверка гипотезы о значимости нелинейной модели регрессии. Проверка гипотезы о линейной зависимости между переменными модели регрессии На нелинейные модели регрессии, которые являются внутренне линейными, т. е. сводимыми к линейному виду, распространяются все

65. Обобщённая модель регрессии. Обобщённый метод наименьших квадратов. Теорема Айткена

65. Обобщённая модель регрессии. Обобщённый метод наименьших квадратов. Теорема Айткена МНК-оценки неизвестных коэффициентов модели регрессии, чьи случайные ошибки подвержены явлениям гетероскедастичности или автокорреляции, не будут удовлетворять теореме

66. Доступный обобщённый метод наименьших квадратов. Взвешенный метод наименьших квадратов

66. Доступный обобщённый метод наименьших квадратов. Взвешенный метод наименьших квадратов Если случайные ошибки модели регрессии подвержены процессу автокорреляции, то для оценивания неизвестных коэффициентов модели регрессии применяется доступный обобщённый метод

90. Косвенный метод наименьших квадратов (КМНК)

90. Косвенный метод наименьших квадратов (КМНК) В системе одновременных уравнений каждое уравнение не может рассматриваться как самостоятельная часть системы, поэтому оценки неизвестных коэффициентов данных уравнений нельзя определить с помощью классического метода