65. Обобщённая модель регрессии. Обобщённый метод наименьших квадратов. Теорема Айткена

65. Обобщённая модель регрессии. Обобщённый метод наименьших квадратов. Теорема Айткена

МНК-оценки неизвестных коэффициентов модели регрессии, чьи случайные ошибки подвержены явлениям гетероскедастичности или автокорреляции, не будут удовлетворять теореме Гаусса-Маркова. Свойствами состоятельности и несмещённости МНК-оценки будут обладать, однако свойство эффективности в этом случае утрачивается.

Для вычисления оценок неизвестных коэффициентов модели регрессии с гетероскедастичными или коррелированными случайными ошибками используется обобщённый метод наименьших квадратов. Оценки, полученные с помощью данного метода, будут удовлетворять условиям состоятельности, несмещённости и эффективности.

В основе нормальной линейной модели регрессии среди прочих лежат условия о некоррелированности и гомоскедастичности случайных ошибок:

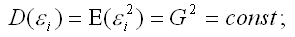

1) дисперсия случайной ошибки модели регрессии является величиной, постоянной для всех наблюдений:

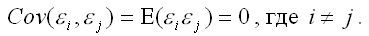

2) случайные ошибки модели регрессии не коррелированны между собой, т. е. ковариация случайных ошибок любых двух разных наблюдений равна нулю:

Определение. Обобщённой линейной моделью регрессии называется модель, для которой нарушаются условия о гомоскедастичности и некоррелированности случайных ошибок.

Таким образом, обобщённая линейная модель регрессии характеризуется неоднородностью дисперсий случайных ошибок:

D(?i)? D(?j)?G2?const, где i?j,

и наличием автокорреляции случайных ошибок:

Cov(?i,?j)?E(?i,?j)?0 (i?j).

Матричный вид обобщённой линейной модели регрессии:

Y=X* ?+?,

где X – неслучайная матрица факторных переменных;

? – случайная ошибка модели регрессии с нулевым математическим ожиданием E(?)=0 и дисперсией G2(?):

?~N(0;G2?),

? – ковариационная матрица случайных ошибок обобщённой модели регрессии.

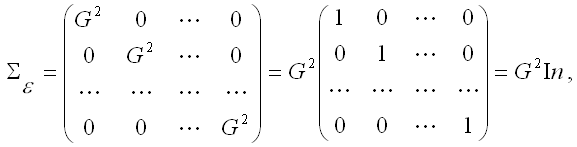

Для нормальной линейной модели регрессии дисперсия случайной ошибки определялась на основе условия гомоскедастичности:

где G2=const – дисперсия случайной ошибки модели регрессии ?;

In – единичная матрица размерности n*n.

Для обобщённой модели регрессии ковариационная матрица случайных ошибок строится на основе условия непостоянства дисперсий остатков модели регрессии (гетероскедастичности) D(?i)? D(?j)?G2?const:

Отличие между нормальной линейной моделью регрессии и обобщенной линейной моделью регрессии заключается в матрице ковариаций случайных ошибок модели.

Теорема Айткена. В классе линейных несмещённых оценок неизвестных коэффициентов обобщённой модели регрессии оценка

будет иметь наименьшую ковариационную матрицу.

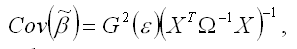

Общая формула для расчёта матрицы ковариаций ОМНК-оценок коэффициентов обобщенной модели регрессии имеет вид:

Величина G2(?) оценивается по формуле:

Однако значение G2(?) не следует трактовать как дисперсию случайной ошибки модели регрессии.

Коэффициент детерминации не используется при оценке качества обобщённой линейной модели регрессии, потому что он не отвечает требованиям, предъявляемым к обычному множественному коэффициенту детерминации.

Проверка гипотез о значимости коэффициентов обобщенной линейной модели регрессии и модели регрессии в целом осуществляется с помощью тех же статистических критериев, что и в случае нормальной линейной модели регрессии.

Более 800 000 книг и аудиокниг! 📚

Получи 2 месяца Литрес Подписки в подарок и наслаждайся неограниченным чтением

ПОЛУЧИТЬ ПОДАРОКДанный текст является ознакомительным фрагментом.

Читайте также

9. Общая модель парной (однофакторной) регрессии

9. Общая модель парной (однофакторной) регрессии Общая модель парной регрессии характеризует связь между двумя переменными, которая проявляется как некоторая закономерность лишь в среднем в целом по совокупности наблюдений.Регрессионным анализом называется

10. Нормальная линейная модель парной (однофакторной) регрессии

10. Нормальная линейная модель парной (однофакторной) регрессии Общий вид нормальной (традиционной или классической) линейной модели парной (однофакторной) регрессии (Classical Normal Regression Model):yi=?0+?1xi+?i,где yi– результативные переменные, xi – факторные переменные, ?0, ?1 – параметры

12. Оценивание неизвестных коэффициентов модели регрессии методом наименьших квадратов. Теорема Гаусса – Маркова

12. Оценивание неизвестных коэффициентов модели регрессии методом наименьших квадратов. Теорема Гаусса – Маркова Определение коэффициентов модели регрессии осуществляется на третьем этапе схемы построения эконометрической модели. В результате этой процедуры

13. Система нормальных уравнений и явный вид ее решения при оценивании методом наименьших квадратов линейной модели парной регрессии

13. Система нормальных уравнений и явный вид ее решения при оценивании методом наименьших квадратов линейной модели парной регрессии Предположим, что в ходе регрессионного анализа была установлена линейная взаимосвязь между исследуемыми переменными х и у, которая

24. Проверка гипотезы о значимости модели парной регрессии. Теорема о разложении сумм квадратов

24. Проверка гипотезы о значимости модели парной регрессии. Теорема о разложении сумм квадратов Проверка гипотезы о значимости линейной модели парной регрессии состоит в проверке гипотез о значимости коэффициентов регрессии ?0 и ?1 или значимости парного коэффициента

26. Линейная модель множественной регрессии

26. Линейная модель множественной регрессии Построение модели множественной регрессии является одним из методов характеристики аналитической формы связи между зависимой (результативной) переменной и несколькими независимыми (факторными) переменными.Модель

27. Классический метод наименьших квадратов для модели множественной регрессии. Метод Крамера

27. Классический метод наименьших квадратов для модели множественной регрессии. Метод Крамера В общем виде линейную модель множественной регрессии можно записать следующим образом:yi=?0+?1x1i+…+?mxmi+?i, где yi – значение i-ой результативной переменной,x1i…xmi – значения факторных

28. Линейная модель множественной регрессии стандартизированного масштаба

28. Линейная модель множественной регрессии стандартизированного масштаба Помимо классического метода наименьших квадратов для определения неизвестных параметров линейной модели множественной регрессии ?0…?m используется метод оценки данных параметров через

42. Метод наименьших квадратов для моделей регрессии, нелинейных по факторным переменным

42. Метод наименьших квадратов для моделей регрессии, нелинейных по факторным переменным Если модель регрессии является нелинейной по факторным переменным или нелинейной по оцениваемым коэффициентам, но внутренне линейной, то неизвестные коэффициенты данных моделей

43. Метод наименьших квадратов для моделей регрессии, нелинейных по оцениваемым коэффициентам

43. Метод наименьших квадратов для моделей регрессии, нелинейных по оцениваемым коэффициентам Показательная функция вида является нелинейной по коэффициенту ?1 и относится к классу моделей регрессии, которые можно с помощью преобразований привести к линейному виду.

52. Метод наименьших квадратов для двухфакторной производственной функции Кобба-Дугласа. Эффект от масштаба производства

52. Метод наименьших квадратов для двухфакторной производственной функции Кобба-Дугласа. Эффект от масштаба производства Двухфакторную производственную функцию Кобба-Дугласа f(K,L) можно представить в виде:Q=A*Ka*L?,где Q – объём выпущенной продукции (в стоимостном или

66. Доступный обобщённый метод наименьших квадратов. Взвешенный метод наименьших квадратов

66. Доступный обобщённый метод наименьших квадратов. Взвешенный метод наименьших квадратов Если случайные ошибки модели регрессии подвержены процессу автокорреляции, то для оценивания неизвестных коэффициентов модели регрессии применяется доступный обобщённый метод

90. Косвенный метод наименьших квадратов (КМНК)

90. Косвенный метод наименьших квадратов (КМНК) В системе одновременных уравнений каждое уравнение не может рассматриваться как самостоятельная часть системы, поэтому оценки неизвестных коэффициентов данных уравнений нельзя определить с помощью классического метода

92. Двухшаговый метод наименьших квадратов (ДМНК)

92. Двухшаговый метод наименьших квадратов (ДМНК) Уравнение называется сверхидентифицированным, если по оценкам коэффициентов приведённой формы системы одновременных уравнений можно получить более одного значения для коэффициентов структурной формы системы

98. Нелинейный метод наименьших квадратов. Метод Койка

98. Нелинейный метод наименьших квадратов. Метод Койка Если модель с распределенным лагом характеризуется бесконечной величиной максимального лага L, то для оценивания неизвестных параметров данной модели применяются нелинейный метод наименьших квадратов и метод